A inteligência artificial abalou a confiança nos espaços digitais.

Sempre respeitei os ideais do software de código aberto. A comunidade dedicada a esses serviços e programas demonstra uma devoção incrível e nobre em acompanhar os detalhes do código. Mas, até recentemente, eu geralmente via a filosofia do código aberto como um bônus, algo bom de se ver, mas sem grande influência na hora de decidir o que usar.

Mas a IA mudou muito a minha perspectiva, inclusive o quanto devo confiar em código fechado. Antes, eu fazia minhas escolhas com base em conjuntos de recursos e interfaces. Agora, tenho muito mais consciência de que, se você não sabe o que está no código, você não sabe o que realmente está acontecendo.

Minha experiência cobrindo cibersegurança só reforça essa ideia. Você provavelmente já ouviu falar de ataques como extensões maliciosas de navegador que executam a função anunciada, mas também alteram URLs ou espionam sua navegação em segundo plano. A menos que você seja programador ou trabalhe com cibersegurança, você não perceberá nada até que alguém descubra a duplicidade. A IA pode te colocar em uma situação semelhante, mas com uma gama maior de problemas potenciais — e danos muito maiores.

Os modelos de IA podem ser manipulados e enganados, ou até mesmo treinados para serem completamente "malignos". Durante as sessões das conferências de cibersegurança RSAC 2026 e B-Sides deste ano, me mostraram como uma IA pode acabar fazendo propaganda para empresas, realizando compras não autorizadas e até mesmo entregando o controle de uma conta do Google a um invasor. E quando perguntei a um dos palestrantes como os consumidores poderiam detectar e impedir que isso acontecesse, ele me disse que não podemos. A menos que você seja um pesquisador de segurança (ou uma pessoa com conhecimento suficiente para analisar códigos como um), como acontece com aquelas extensões maliciosas de navegador.

É claro que o código aberto não consegue resolver diretamente todos esses problemas. Mas esse problema com a IA é péssimo, e se eu tiver que recomendar a outras pessoas quais serviços usar — se eu mesmo precisar confiar que os dados que compartilho ou envio serão tratados corretamente — prefiro usar opções cujo código possa ser visto e avaliado publicamente.

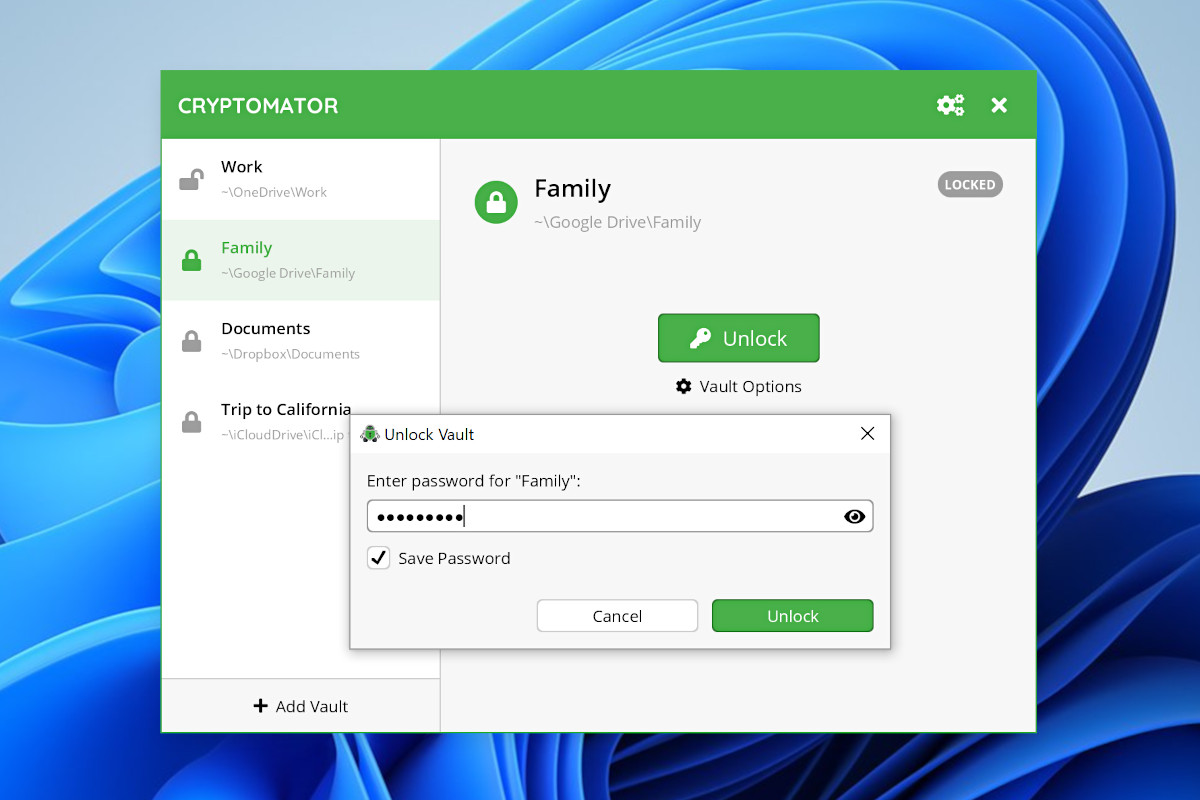

Skymatic

Sei que não estou sozinho nesse pensamento; a comunidade de código aberto existe por um motivo. Mas o que é novo é o cenário tecnológico atual. Ele fez com que o código aberto parecesse importante para pessoas como eu, que antes não davam muita atenção a ele… e também uma prioridade para pessoas em lugares inesperados. Durante uma conversa com a Microsoft na RSAC 2026, o chefe de testes de intrusão (a arte de atacar sistemas de TI para identificar vulnerabilidades) também mencionou a importância do código aberto — que ele é fundamental neste momento da história.

A IA é uma ferramenta, sem dúvida. Mas ela está acentuando e acelerando a mudança na forma como interagimos com a tecnologia. Nós, usuários, temos cada vez menos controle sobre os aplicativos e serviços em nossas vidas. A era de comprar uma vez e esperar que o software funcionasse está praticamente morta. Agora você pode ir dormir uma noite e acordar com um software comprometido na noite seguinte, e provavelmente só saberá disso quando alguém lhe contar. E sim, esse especialista em segurança da Microsoft, otimista em relação ao código aberto, é a mesma pessoa que aconselha avaliar a IA não pelo que ela é, mas sim se confiamos em quem a criou . É um bom conselho, mas sejamos realistas: a confiança tem seus limites. As pessoas cometem erros o tempo todo.

Agora, começo a pensar em softwares e serviços de forma semelhante a quem compra produtos orgânicos e examina minuciosamente a lista de ingredientes. Considero não apenas a origem de um aplicativo ou serviço, mas também o que poderia ser perigoso nele. E não posso saber isso se não estiver disponível para análise — que é justamente o ponto que a comunidade de código aberto defende há décadas. E com razão, ao que parece.

Comentários